Empiler plusieurs serveurs indépendants sur un seul ordinateur : loin d’un gadget, cette tactique est devenue un véritable moteur de performance pour l’entreprise. La virtualisation des serveurs bouleverse en profondeur la façon de piloter les infrastructures informatiques. Grâce à elle, il devient possible de faire fonctionner plusieurs machines virtuelles sur le même serveur physique, d’optimiser chaque composant jusqu’au dernier octet et de réduire aussi bien les achats de matériel que la consommation d’énergie.

Au cœur du quotidien, les équipes informatiques expérimentent une agilité nouvelle. Créer, déplacer ou cloner une machine virtuelle ne requiert plus que quelques minutes. Ce qui, hier encore, imposait des heures de manipulations techniques, s’accomplit désormais en un clin d’œil. Maintenance, sauvegardes, gestion des incidents : la virtualisation simplifie chaque étape. Résultat tangible, l’environnement informatique gagne en robustesse, prêt à faire face à l’imprévu sans jamais mettre l’activité en difficulté.

A lire en complément : Les entreprises ont souvent besoin d'un conseiller

Qu’est-ce que la virtualisation des serveurs et comment fonctionne-t-elle ?

Virtualiser un serveur consiste à diviser une machine physique en plusieurs environnements indépendants. Chacun fonctionne comme un serveur autonome, avec ses propres réglages et systèmes, tout en cohabitant sur un même support matériel. Cette méthode modifie les habitudes, maximise l’utilisation des ressources et redonne du sens à l’organisation informatique.

Trois piliers structurants de la virtualisation

Pour saisir le mécanisme de la virtualisation, il est nécessaire de passer en revue les trois piliers qui la composent :

A découvrir également : Gestion des jours ouvrés 2024 pour les entreprises

- Serveur physique : la fondation matérielle, support de l’ensemble de l’écosystème virtuel.

- Serveurs virtuels : des environnements logiciels distincts, chacun bénéficiant de ses propres réglages, isolés, mais partageant le même socle matériel.

- Hyperviseur : ce programme pilote répartit finement les ressources entre les serveurs virtuels et veille à leur indépendance.

L’hyperviseur, le stratège de l’ombre

La distribution de la mémoire, des processeurs et du stockage est orchestrée par l’hyperviseur. Même si les machines virtuelles partagent la même base physique, chacune reste cloisonnée. Ce fonctionnement compartimenté offre la possibilité d’ajuster les performances à la volée, de prioriser selon les exigences du moment.

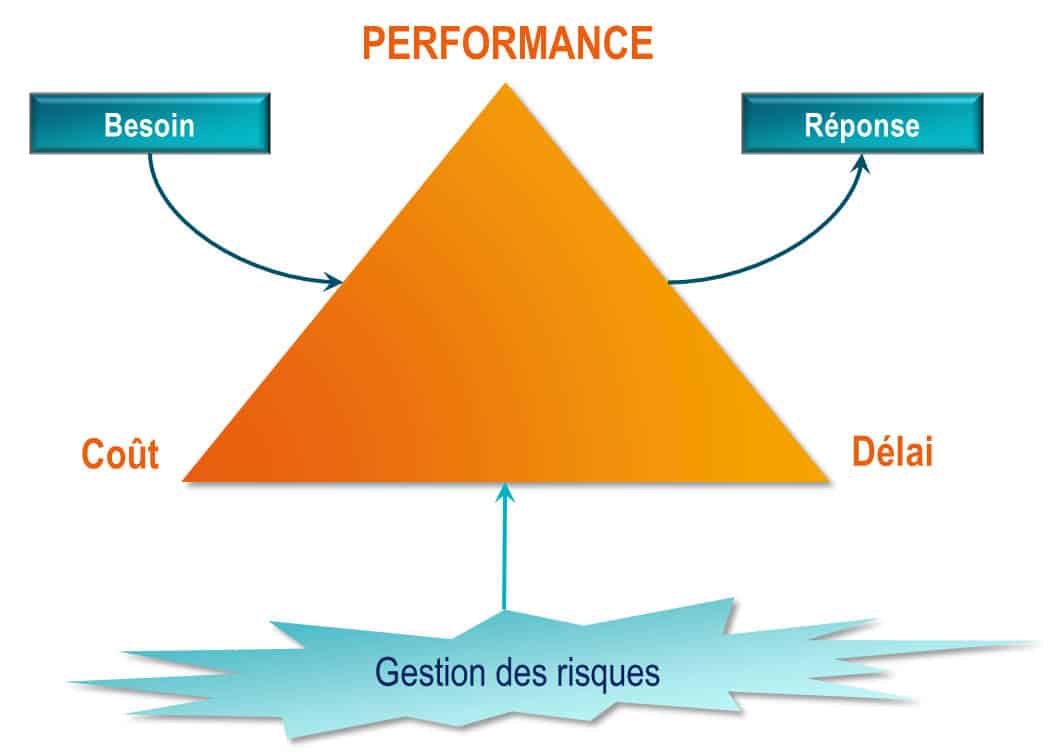

Pour ceux qui souhaitent bénéficier d’une virtualisation des serveurs, ce modèle rime avec centralisation, optimisation et agilité. L’entreprise peut restaurer une machine virtuelle à la demande, la déplacer ou la dupliquer en cas de défaillance technique. Ces capacités renforcent la gestion des risques et l’aptitude à réagir face aux imprévus.

Ce fonctionnement, taillé sur mesure, apporte une souplesse qui dépasse largement les limites des architectures matérielles classiques.

Les avantages de la virtualisation des serveurs pour les entreprises

Qu’est-ce qui pousse autant d’entreprises, de la PME au grand groupe, à franchir le cap ? Plusieurs bénéfices concrets rendent la virtualisation particulièrement séduisante :

- Réduction des coûts : mutualiser les serveurs sur une seule machine permet de limiter les dépenses en matériel, en maintenance et en électricité.

- Exploitation optimale des ressources : chaque composant trouve sa fonction, sans gaspillage ni sous-utilisation.

- Flexibilité et rapidité : créer ou supprimer un environnement s’effectue rapidement, ce qui rend l’informatique capable de suivre l’évolution des besoins métiers sans perturber l’organisation.

Résilience face aux incidents et sécurité renforcée

Un incident sur une machine virtuelle n’entraîne pas la chute de l’ensemble du système. Cette séparation freine la propagation des pannes ou des attaques. Si un problème survient, transférer ou dupliquer un serveur virtuel se fait sans délai, limitant ainsi les conséquences sur l’activité.

Gestion centralisée et modernisation continue

Superviser tous les serveurs depuis une interface unique simplifie considérablement la vie des administrateurs. Les interventions physiques se font rares, la gestion quotidienne s’allège nettement. Pour une entreprise en pleine croissance, multi-sites ou intégrant de nouveaux services, ce confort et ce gain de temps deviennent rapidement des leviers de compétitivité.

La virtualisation ouvre aussi la voie aux architectures hybrides, associant serveurs internes et solutions cloud. Les équipes gardent la maîtrise de leur système tout en profitant de la souplesse du cloud computing. Ce duo prépare un socle informatique évolutif, prêt à s’adapter aux nouveaux défis.

Comment bâtir une stratégie de virtualisation efficace

Observer, analyser, évaluer

La réussite d’un projet de virtualisation commence toujours par une évaluation minutieuse des besoins réels de l’organisation. Il s’agit de passer en revue les usages, de prévoir les évolutions et d’anticiper les ressources indispensables. Pour cadrer ce diagnostic, mieux vaut examiner de près les points suivants :

- Capacité de calcul : quelle puissance doit être réservée à chaque application pour garantir leur fluidité ?

- Stockage : quel volume d’espace prévoir, selon la nature et la quantité des données traitées ?

- RAM : quelle quantité de mémoire vive allouer à chaque serveur virtuel pour assurer la stabilité ?

Choisir la solution adaptée

La performance globale du système dépend fortement du choix de l’hyperviseur. Plusieurs critères pèsent dans la balance :

- Compatibilité : il doit pouvoir gérer tous les systèmes d’exploitation utilisés sur l’infrastructure, côté matériel comme virtuel.

- Performance : la disponibilité des ressources doit rester stable, même lors des pics d’activité.

- Sécurité : il faut intégrer des mécanismes fiables pour protéger les environnements virtuels contre les menaces extérieures.

Déploiement progressif et tests rigoureux

La virtualisation demande de la méthode. Chaque étape se prépare, les responsabilités sont réparties, et les fonctionnalités sont testées dans un environnement sécurisé avant de passer en production. Cette démarche réduit les mauvaises surprises et assure une transition fluide.

Faire évoluer et ajuster en continu

La mise en œuvre de la virtualisation n’est qu’une première étape. Pour suivre le rythme, il faut surveiller l’utilisation des ressources, affiner les réglages et intégrer régulièrement de nouvelles solutions. Les outils de supervision jouent alors un rôle clé : ils permettent d’adapter la configuration selon les besoins et les avancées technologiques.

La virtualisation des serveurs s’impose désormais comme une stratégie durable. Elle insuffle aux directions informatiques une capacité d’adaptation inédite, forgeant des infrastructures prêtes à absorber les chocs comme les ambitions les plus audacieuses. Ceux qui s’engagent dans cette voie ne se contentent pas de suivre le mouvement : ils participent activement à la construction du paysage numérique des années à venir.